Come l’AI sta uccidendo i social aumentando l’effetto spazzatura

Come l’intelligenza artificiale ha colonizzato il reale, svuotato i social e trasformato il linguaggio in spazzatura.

Di Alessandro Cammarano

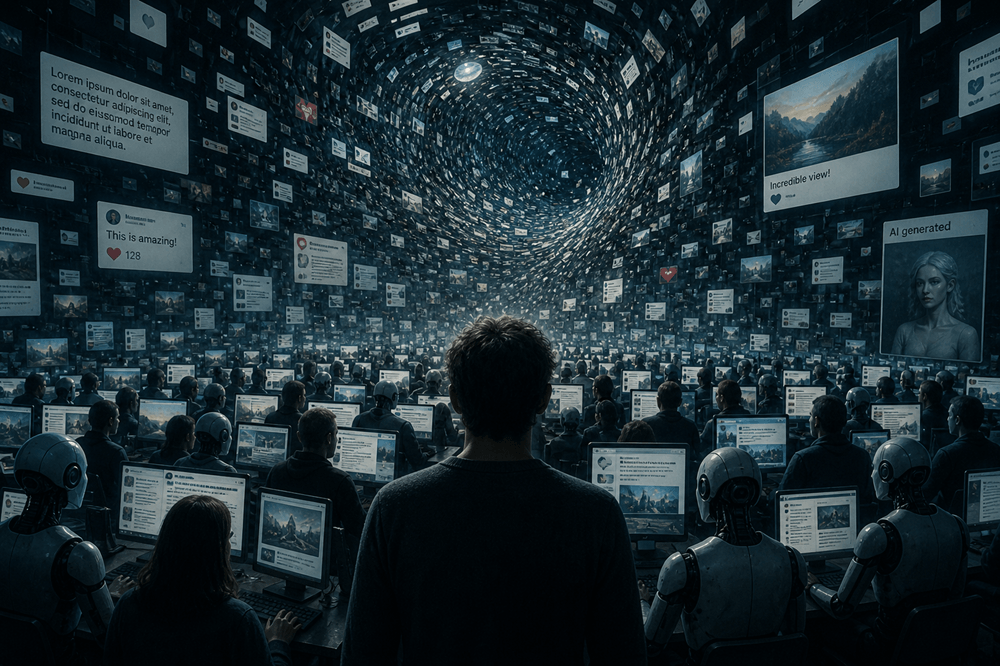

C’è un esperimento mentale che circola da qualche tempo negli ambienti più avvertiti della teoria dei media, e che si potrebbe riassumere così: immaginate di entrare in una stanza affollata dove tutti parlano contemporaneamente. Le voci sono fluenti, articolate, formalmente impeccabili. Poi vi accorgete che nessuno sta ascoltando, perché nessuno sta parlando davvero. Le voci escono da altoparlanti. Gli altoparlanti si alimentano l’uno dell’altro. Nessun essere umano è presente nella stanza. Benvenuti in internet, anno 2025.

Non è fantascienza e non è metafora. È la descrizione abbastanza fedele di ciò che è diventato il web dopo l’adozione di massa dei modelli generativi.

Nel 2024, per la prima volta nella storia della rete, il traffico automatizzato ha superato quello umano: i bot hanno rappresentato il 51% di tutta l’attività online mondiale. Non il 20, non il 30: il 51, la maggioranza assoluta, raggiunta in silenzio, senza che nessuno si prendesse la briga di annunciarla.

Su X, già Twitter, quasi due terzi degli account sarebbero di origine artificiale, responsabili di tre quarti del traffico di punta. Su Instagram, decine di milioni di profili sarebbero falsi o automatizzati. Le aziende tecnologiche interessate praticano, su questi dati, un silenzio che è già una risposta.

Tutto questo ha trovato, nel 2025, una parola. Non è una parola elegante: si chiama slop, traducibile approssimativamente come “pastone”, “brodaglia”, “scarti”. È stata eletta parola dell’anno da dizionari autorevoli su entrambe le sponde dell’Atlantico, e persino dal dizionario nazionale australiano — un riconoscimento trasversale che racconta, meglio di qualsiasi analisi, quanto il fenomeno sia percepito come definitorio di un’epoca.

L’AI slop è il contenuto digitale prodotto in massa dalla generazione automatica, privo di qualsiasi intenzione comunicativa autentica, concepito unicamente per catturare attenzione e monetizzarla. “Spazzatura digitale”, “contenuto di riempimento che privilegia velocità e quantità su sostanza e qualità”: le definizioni si moltiplicano, ma descrivono la stessa cosa.

Un filosofo americano lo ha descritto come dotato di uno stile “incredibilmente banale e realistico”, facile da consumare e ancora più facile da ignorare, se non fosse che ignorarlo è ormai impossibile, perché ovunque si guardi non c’è altro.

Le menzioni di AI slop su internet sono aumentate di nove volte in un anno solo. Gli articoli generati dall’AI costituiscono oggi più della metà di tutti i contenuti in lingua inglese sul web.

Un’analisi condotta su quasi un milione di nuove pagine in lingua inglese ha stimato che oltre il 74% conteneva materiale generato artificialmente. Solo il 25% era classificabile come puramente umano. Il rovesciamento è avvenuto silenziosamente, senza cerimonie, come avviene con tutte le catastrofi ambientali: prima non se ne vedono gli effetti, poi non si riesce più a ricordare com’era prima.

Il problema non è la quantità. È la natura.

Si potrebbe obiettare: internet è sempre stato pieno di spazzatura.

Vero. Ma la spazzatura precedente era, almeno, spazzatura umana. Aveva un’origine, un’intenzione riconoscibile, persino una grammatica del fallimento che la rendeva identificabile. La nuova spazzatura è diversa. È fluente. È formalmente corretta. Si veste da informazione, si spaccia per analisi, imita la profondità. Ed è prodotta a costo tendente a zero, in quantità industriali, da sistemi addestrati a sembrare credibili piuttosto che a essere veri.

Man mano che i contenuti generati artificialmente contaminano i dataset di addestramento, gli output dei modelli diventano progressivamente più incoerenti e scollegati dalla realtà come in un gioco del telefono in cui ogni iterazione risulta più corrotta della precedente. Il fenomeno ha un nome tecnico: model collapse, collasso del modello. Descrive il processo per cui i sistemi di intelligenza artificiale, costretti ad allenarsi su testi prodotti da altri sistemi di intelligenza artificiale, degenerano in modo progressivo. Studiosi di Princeton hanno argomentato in modo persuasivo che l’AI ha già rappresentato “uno shock malsano” per la ricerca scientifica, “spingendo molti dei suoi processi al limite della rottura”.

Internet diventa una sala degli specchi, dove la vera competenza è superata in numero da simulazioni di simulazioni.

Nel 2024 è circolato — prima di essere ritirato — un articolo accettato da una rivista scientifica contenente un’immagine generata dall’AI raffigurante un ratto con genitali di dimensioni assurde, accompagnata da testo e diagrammi privi di senso. Non su una rivista di infimo livello: su una testata che conta nelle carriere accademiche. Un ricercatore ha definito questo genere di materiali un “cancerogeno epistemico” per l’intero ecosistema della conoscenza. La metafora medica non è scelta a caso.

Il quadro quantitativo è, se possibile, ancora più cupo di quello qualitativo. Sette intervistati su dieci, nelle rilevazioni più recenti sulla fiducia nei media, temono che i giornalisti ingannino deliberatamente il pubblico. Solo il 40% della popolazione si fida delle notizie. L’interesse per l’informazione è in caduta libera, con un calo di 15 punti percentuali rispetto al 2017. Meno della metà degli americani ritiene che ciò che legge online sia accurato e di produzione umana. Quasi l’80% trova più difficile che mai distinguere i contenuti umani da quelli artificiali.

Il 71% delle immagini condivise sui social è generato dall’intelligenza artificiale.

Su LinkedIn, oltre la metà dei post di lunga forma è probabilmente composta da un algoritmo. La rete professionale per eccellenza, il luogo dove le persone dovrebbero presentarsi per come sono, è diventata una vetrina di identità sintetiche che parlano di “ecosistemi di valore” e “approcci olistici” in frasi che nessun essere umano dotato di amor proprio scriverebbe di propria mano. Quasi il 60% dei consumatori dubita dell’autenticità di ciò che vede online. Più della metà mette sistematicamente in discussione le recensioni che legge.

I social non sono morti. Sono stati trasformati in qualcos’altro.

La “dead internet theory” è nata come teoria del complotto su forum di nicchia nel 2021. Sosteneva che la maggior parte di ciò che vediamo online non fosse prodotto da esseri umani ma da bot e algoritmi. Veniva derisa. Oggi è oggetto di dibattito accademico, citata dai fondatori di Reddit, confermata nei suoi elementi fondamentali dal CEO di OpenAI. “Non avevo mai preso sul serio la dead internet theory”, ha scritto Sam Altman nell’autunno scorso, “ma sembra che ci siano davvero molti account gestiti da modelli linguistici.”

Il cofondatore di Reddit Alexis Ohanian è andato oltre: “la dead internet theory è reale.”

Depurata dai suoi elementi paranoici, la teoria descrive qualcosa di verificabile: lo spostamento progressivo dei contenuti umani da parte di quelli artificiali, la crescente impossibilità di distinguerli, e la sfiducia strutturale che ne consegue.

Non si tratta di un complotto. Si tratta di incentivi economici applicati a scala industriale. “Gli ecosistemi online seguono gli incentivi. Quando il falso coinvolgimento è a basso costo e premiato, non ottieni solo più bot. Ottieni catene di montaggio di contenuti automatizzati che inseguono i clic.”

Il risultato pratico è che i social network, che avevano almeno la pretesa di essere piazze di scambio umano, si sono trasformati in ambienti in cui la presenza umana è minoritaria e quella artificiale dominante, dove le metriche di engagement sono gonfiate da interazioni tra macchine, dove il confine tra un’opinione autentica e una narrativa costruita da una farm di contenuti è diventato, per l’utente medio, semplicemente invisibile.

La lingua come terreno contaminato

C’è un elemento che viene discusso meno degli altri, forse perché è il più difficile da misurare e il più perturbante da contemplare. L’intelligenza artificiale generativa non ha solo inondato internet di contenuti: ha cambiato la lingua. Non nel senso che ha introdotto neologismi o modificato la sintassi. Nel senso che ha prodotto un’enorme massa di testo formalmente corretto, semanticamente vuoto e stilisticamente omogeneo, che ora circola, viene letto, viene a sua volta usato come modello inconsapevole.

I sistemi AI si addestrano sempre più su testi prodotti da altri sistemi AI, che si erano a loro volta addestrati su testi umani, i quali però rappresentano oggi una percentuale decrescente del totale disponibile. Il risultato è una spirale di degradazione in cui la qualità media del linguaggio si abbassa progressivamente, e i nuovi modelli ereditano e amplificano quella degradazione. Non è un problema solo tecnico. È un problema culturale. La lingua non è uno strumento neutro: è il medium attraverso cui il pensiero si forma, si comunica, si trasmette. Una lingua impoverita non è solo meno bella: è meno precisa, meno capace di descrivere la realtà complessa. E quando quella lingua diventa il modello su cui si formano le generazioni successive — non solo i sistemi AI, ma gli esseri umani che leggono e scrivono immersi in quell’ambiente — il danno è di ordine epistemico prima ancora che estetico.

Né panico né rassegnazione

C’è chi dice che andrà meglio. Che i sistemi di rilevamento miglioreranno. Che le piattaforme introdurranno etichette obbligatorie. Sono argomenti seri. Ma i sistemi di revisione dei principali motori di ricerca sono manuali e non riescono a tenere il passo con i milioni di contenuti generati ogni giorno. L’asimmetria è strutturale: produrre contenuti artificiali costa una frazione di ciò che costa produrne di autentici, e quella differenza non si ridurrà con il miglioramento della tecnologia, semmai aumenterà.

La verità, come ogni risorsa condivisa, si degrada quando viene trascurata. Il problema non è l’intelligenza artificiale in quanto tale. È l’intelligenza artificiale applicata all’economia dell’attenzione, in un ambiente privo di regole, con incentivi che premiano la quantità sull’autenticità e la velocità sulla verità. Il risultato è un debord ambientale, un inquinamento non dell’aria o dell’acqua, ma dello spazio informativo comune, di quella risorsa immateriale e fondamentale che è la possibilità di sapere, con ragionevole certezza, se ciò che si sta leggendo è stato scritto da un essere umano con un’intenzione, o generato da una macchina per riempire uno spazio pubblicitario.

Chi pensa che questa sia una questione tecnica ha torto. È una questione di ecologia della conoscenza. E l’ecosistema è già in crisi.